Kiedy tylko zrealizuję mój plan, natychmiast zajmę się połączeniem swojego mózgu z zewnętrznymi interfejsami. Najbardziej interesuje mnie, co by się stało, gdybym połączył się z inną osobą. Z jej mózgiem – mówi dr Andrzej Banburski z MIT w rozmowie z Moniką Redzisz

Monika Redzisz: Jest pan naukowcem, a zadaje pan pytania filozoficzne. Choćby takie: „Jedną z moich największych motywacji jest ustalenie, czy istnieją ramy naukowe pozwalające odpowiedzieć na pytanie „dlaczego istnieje coś, a nie nic?” – pisze pan na swojej stronie internetowej. Czy nauka w ogóle odpowiada na takie pytania?

Andrzej Banburski*: Ja zawsze zadawałem sobie pytania filozoficzne. Dlaczego istnieje coś, a nie nic? Jak działa wszechświat? Właśnie dlatego zainteresowałem się fizyką, jeszcze w liceum w Gdyni. Doszedłem do wniosku, że najbardziej zbliżę się do odpowiedzi na te pytania, jeśli będę studiował teorię kwantowej grawitacji – dziedzinę łączącą mechanikę kwantową i teorię grawitacji Einsteina. To Święty Graal fizyki. Ta teoria właściwie nie istnieje, a przecież wiemy, że istnieć musi, bo istnieją przynajmniej dwa punkty we wszechświecie, w których musi działać: czarne dziury i Wielki Wybuch. Doktorat zrobiłem z pętlowej grawitacji, czyli jednej z teorii grawitacji kwantowej, która też właściwie nie istnieje. Mamy modele, które tylko mniej więcej współdziałają z tym, co obserwujemy w astrofizyce. Dopóki nie będziemy mieli porządnej teorii, nie będziemy mogli niczego obliczyć.

Co na przykład obliczyć?

Na przykład gdybyśmy mieli zderzacz hadronów w skali galaktycznej i chcieli stworzyć czarną dziurę, to nie mamy pojęcia, co by się stało. Nie możemy obliczyć, czy podróż w czasie jest możliwa. Albo czy można podróżować szybciej niż światło. Gdybyśmy mieli tę teorię, moglibyśmy odpowiedzieć na szereg bardzo interesujących pytań, dlatego postanowiłem ją stworzyć. Ale prawda jest taka, że to niesamowicie trudne zadanie…

Jak to się ma do tego, czym pan teraz się zajmuje? Pracuje pan w Massachusetts Institute of Technology i zajmuje się sztuczną inteligencją. Dlaczego się pan nią zainteresował?

To było tak: zawsze myślałem, że zostanę w fizyce, ale w trakcie doktoratu w Instytucie Fizyki Teoretycznej w Kanadzie miałem okazję, by skoczyć w bok. Zostałem zaproszony na wakacje do Microsoftu. Potrzebowali ludzi, którzy zrobiliby aplikacje do ich nowego produktu, HoloLensów. Zainteresowało mnie to. Miałem kilka pomysłów, ale nie wiedziałem dokładnie, co ta technologia jest w stanie zrobić. Zacząłem się zastanawiać, jak by to było, gdybyśmy, mając dostęp do trzech wymiarów, nie musieli przeprowadzać obliczeń matematycznych na papierze albo na tablicy. Czy inaczej by się myślało o matematyce?

Miał pan nadzieję, że da się przenieść matematykę do 3D? Ale właściwie po co wizualizować równania matematyczne?

Największą częścią kory mózgowej jest kora wzrokowa. Pomyślałem, że jeśli udałoby się nam przerzucić działania matematyczne do trzech wymiarów, to moglibyśmy szybciej myśleć, efektywniej rozwiązywać matematyczne zagadki.

Jeśli udałoby się nam przerzucić działania matematyczne do trzech wymiarów, to moglibyśmy szybciej myśleć, efektywniej rozwiązywać matematyczne zagadki

A można w ogóle zlokalizować myślenie matematyczne w korze wzrokowej?

Nie wiemy, które obszary mózgu zajmują się liczbami, ale matematyka to nie tylko arytmetyka. Ja zawsze miałem poczucie, że matematycy, licząc, wyobrażają sobie równania. I że gdyby mieli możliwość ich wizualizacji, gdyby mogli wejść do takiej przestrzeni i zobaczyć te obiekty, to mieliby więcej możliwości. Chciałem stworzyć platformę, na której dwóch matematyków mogłoby ze sobą współpracować – co zdarza się rzadko, bo o matematyce trudno jest mówić. Zrobiłem więc aplikację HoloMath, która pozwala na wizualizację danych. Kiedy się założy okulary i włączy aplikację, pojawia się trójwymiarowe menu. Wszystkim steruje się głosem. Jeśli kilka osób założy HoloLensy, wszystkie mogą zobaczyć to samo. Można przechadzać się pomiędzy obiektami i robić różne działania.

Można zobaczyć i wykonać dowolne działanie matematyczne?

Do pewnego poziomu skomplikowania – tak. Kategorie na przykład trudno zwizualizować, ale dane, funkcje, macierze – z tym łatwo sobie poradzić. Można spojrzeć na nie z kilku stron, myśleć przestrzennie.

Można korzystać z tej aplikacji?

Niestety nie. Mam z tego patent, ale kupić aplikacji nie można. Prawdę mówiąc, to moja wina; powinienem był opublikować wyniki. Sądzę, że gdybym pociągnął to trochę dalej, byłoby to naprawdę przydatne narzędzie dla wielu fizyków i matematyków… Ale mój plan się powiódł tylko częściowo. Trudno jest mówić o matematyce bez pisania. Może matematycy by się dogadali z moją aplikacją, o ile operują identycznymi symbolami, ale ktoś inny mógłby mieć problem.

Poza tym musiałem skorzystać z systemu, który jest w stanie operować na symbolach. Jest jeden taki na rynku – język programowania dla matematyki. Działaliśmy na ich licencji, ale współpraca była trudna. Poza tym musiałem już wracać do Kanady, do mojego instytutu. Mój dyrektor chciał zresztą nawet stworzyć osobny wydział, który by się tym zajął, ale ostatecznie pomysł upadł ze względów finansowych.

Był pan wtedy świeżo po doktoracie. Co potem?

Zacząłem się zastanawiać, co mnie najbardziej interesuje. Doszedłem do wniosku, że wciąż fizyka teoretyczna. Miałem jednak poczucie, że ja, jako Homo sapiens, nie jestem zbyt dobrze przystosowany do rozwiązywania tego typu zagadnień. To ewolucyjny przypadek, że jesteśmy w stanie prowadzić badania matematyczne. Weźmy taki galaktyczny zderzacz hadronów: eksperymentalna weryfikacja ewentualnej teorii kwantowej grawitacji zajęłaby mi pewnie jakieś 10 tysięcy lat! Nie chciałem pracować nad czymś, czego wyników nie dożyję. Zacząłem się zastanawiać, jak by to było, gdybyśmy byli bardziej inteligentni. Albo – nieśmiertelni. Jak to osiągnąć? Może gdybym miał możliwość połączenia się z komputerem…

Zacząłem czytać o interfejsach między mózgiem i komputerami. Potrafimy już kontrolować robotyczne protezy. A gdybyśmy kontrolowali zewnętrzny sztuczny mózg? Sztuczny mózg nie ma ograniczeń, jeśli chodzi o wielkość, nie musi się zmieścić w czaszce, nie muszę go nosić. Mogę sobie wszczepić implant i łączyć się z nim za pomocą internetu. Może w pewnym momencie używałbym go bardziej niż własnego? Teoretycznie mógłbym się do niego całkowicie przenieść. Czy to nie oznacza nieśmiertelności? Doszedłem do wniosku, że powinienem go zbudować. W ten sposób doszedłem do idei sztucznej inteligencji; akurat wtedy dostałem ofertę z MIT. Prawdę mówiąc, od dzieciństwa chciałem tu pracować, bo bohater gry komputerowej Half-Life, w którą grałem godzinami jako dzieciak, był fizykiem z MIT. To była gra roku 1998.

A na dokładkę MIT to jedno z najlepszych miejsc do prowadzania badań nad sztuczną inteligencją.

Właśnie. Zaprosił mnie prof. Tomaso Poggio, ponieważ chciał zrozumieć, jak tak naprawdę działają głębokie sieci neuronowe. Działają całkiem dobrze, ale nie wiemy dlaczego. Matematycznie tego nie rozumiemy. Wiemy o tym mniej więcej tyle, co o neuronach w mózgu: że mają warstwy, że robią coś, co przypomina filtrowanie danych – podobnie jak w pierwszej warstwie kory wzrokowej, w której neurony postrzegają linie skośne, a kolejne warstwy reagują na coraz bardziej skomplikowane wzory.

Potrafimy już kontrolować robotyczne protezy. A gdybyśmy kontrolowali zewnętrzny sztuczny mózg? Może w pewnym momencie używałbym go bardziej niż własnego?

Mówi się, że sieci neuronowe to czarne skrzynki.

Tak, dosłownie! Typowe sieci mają miliony parametrów. To modele statystyczne, a jednak nie działa tu podstawowa zasada modeli statystycznych, o których uczy się student I roku statystyki, że musi być mniej parametrów niż danych. W sztucznych sieciach neuronowych mamy, powiedzmy, 50 tysięcy danych i miliony parametrów. Im więcej parametrów, tym lepiej sieci działają. Dlaczego? Nie wiadomo. Tu się dzieje coś podobnego jak w mózgu. Każdy neuron/parametr sam z siebie nie jest ważny, są do siebie podobne, ale im więcej ich jest, tym bardziej stabilna będzie sieć.

Potrafi pan otworzyć czarną skrzynkę?

Pracuję nad tym. Próbuję stworzyć sieć, która by nam wytłumaczyła, dlaczego wygenerowała taki, a nie inny wynik. Kiedy pokażemy jej zdjęcie kota, ona poda powody, dla których klasyfikuje obrazek jako wizerunek kota. „To jest kot, bo ma ogon, uszy, futerko itd.”. Kiedy podejmie decyzję, będzie umiała podać jej powód. „Nie dam pani kredytu z tego i tego powodu”. Jeżeli to sensowny powód, to nam to wystarczy.

Czy wtedy będziemy mogli im ufać?

W ograniczonym zakresie – tak. Z tymi sieciami jest jeszcze taki problem, że łatwo można je zaatakować. Powiedzmy, że to jest sieć neuronowa, która prowadzi samochód. Albo taka, która klasyfikuje obrazy. Mała modyfikacja, całkowicie nierozpoznawalna dla naszych oczu, może zmienić jej działanie. Pokażemy jej kota, a ona powie, że widzi samolot.

Niebezpieczne.

Bardzo. Wydrukowaliśmy w MIT małego zabawkowego żółwia, w którym lekko zmodyfikowana sieć neuronowa rozpoznała karabin. A można i w drugą stronę – sieć neuronowa na lotnisku służąca ochronie może karabin wziąć za dziecięcą zabawkę i zapewnić, że to bezpieczny przedmiot. Już zaatakowano w ten sposób Teslę. Mała nalepka naklejona na znak drogowy STOP sprawiła, że samochód rozumiał ten znak zupełnie inaczej. Dość łatwo wprowadzić takie zakłócenia. Te sieci są strasznie niestabilne.

Można je w jakiś sposób uodpornić na ataki?

Pracujemy nad tym.

Często wini się złe, stronnicze dane; pan mówi o wewnętrznej słabości – niestabilności.

Tak, bo podejrzewam, że z danymi problem będzie zawsze. Nikt nie jest do końca bezstronny. Ludzie, którzy tworzą te sieci, też mają swoje uprzedzenia, choćby podświadome. Zawsze jest coś, co lubimy bardzo, i coś, czego bardzo nie lubimy. Inaczej zresztą nie moglibyśmy podjąć żadnej decyzji. Ale to powoduje, że systemy nigdy nie będą bezstronne.

Czy da się w ogóle uniknąć tej niestabilności? Przecież im coś jest bardziej skomplikowane, tym bardziej narażone na zakłócenie.

Owszem, ale nas, ludzi, nie tak łatwo oszukać. Niełatwo przekonać nas, że widzimy coś innego, niż widzimy, mimo że nasza kora wzrokowa jest dość skomplikowana. Zaczęliśmy się nad tym zastanawiać. Co takiego ma ludzki mózg, czego nie mają modele? Przykład: ponieważ największą rozdzielczość mamy w centrum naszego pola widzenia, musimy na obiekt spojrzeć kilka razy, żeby zrozumieć, co widzimy. Tego sieci neuronowe nie robią. Musimy znaleźć więcej takich elementów.

Ludzie potrafią uczyć się na bardzo niewielu przykładach, w przeciwieństwie do głębokich sieci neuronowych. Może nasz mózg nie jest tabula rasa w momencie narodzin? Dziecko po urodzeniu za dużo nie widzi, ale podobno od urodzenia rozpoznaje schemat ludzkiej twarzy.

Czy ewolucja zaprogramowała nam rozpoznawanie twarzy? Przeprowadzono ciekawe badania na małpkach, które zaraz po urodzeniu zostały odizolowane od innych. Osoby, które się nimi opiekowały, miały zasłonięte twarze, więc przez kilka pierwszych miesięcy małpki nie widziały żadnej twarzy. Kiedy zostały wreszcie wpuszczone do stada, a ich opiekunowie zdjęli maski, w mózgach małpek nie aktywował się ten obszar mózgu, który aktywuje się u małego dziecka na widok twarzy. Pytanie, czy aktywował się na widok czegoś innego? Owszem – na widok rąk. Ponieważ to ręce kojarzyły im się z tym, co karmi i chroni.

Próbuję stworzyć sztuczne sieci neuronowe, które będą w stanie rozumować symbolicznie, abstrakcyjnie, logicznie

Nie jest to więc wrodzony odruch. Dzieci uczą się tego w pierwszych dniach życia, ponieważ kojarzą twarz opiekuna z tym, co daje im jedzenie i bezpieczeństwo. Prawda jest taka, że niemal wszystkiego musimy się nauczyć. Tyle tylko, że do trzeciego roku życia dostajemy mnóstwo informacji, miliardy danych i obrazów.

Pamiętam, że chciał pan zwiększyć nasze możliwości intelektualne. W jakimś konkretnym celu?

By móc szybciej rozwiązywać problemy matematyczne. Zacząłem się zastanawiać, czy można stworzyć sztucznego matematyka – sztuczną inteligencję, która by rozwiązywała zadania matematyczne. Jak dotąd sieci neuronów są przecież tragiczne, jeśli chodzi o jakiekolwiek symboliczne i abstrakcyjne rozumowanie. Nie są w stanie poprawnie dodawać. Może dałyby radę dodawać w zakresie od minus 400 do plus 400, ale nic więcej. I to jest duży problem. My mamy w mózgu dwa systemy rozumowania: jeden bardziej skojarzeniowy, a drugi – logiczny, a oba ze sobą współpracują. Sieci neuronowe działają wyłącznie na zasadzie skojarzeń i nie są w stanie przeprowadzić żadnych operacji logicznych. Żadna sieć neuronowa nie przeprowadzi dowodu matematycznego. To mój drugi temat w MIT: próbuję stworzyć sztuczne sieci neuronowe, które będą w stanie rozumować symbolicznie, abstrakcyjnie, logicznie. Podejrzewam, że będę się tym zajmował przez następnych kilka lat.

Ciekawa jestem, co dalej.

Kiedy tylko zrealizuję mój plan, natychmiast zajmę się połączeniem swojego mózgu z zewnętrznymi interfejsami – choć nie jestem do końca pewien, czy uda mi się stworzyć wystarczająco kompatybilną architekturę. W zasadzie najbardziej interesuje mnie, co by się stało, gdybym połączył się z inną osobą. Z jej mózgiem.

Czy bylibyśmy w stanie myśleć wspólnie? Czy mógłbym patrzeć na jego lub jej myśli? Podejrzewam, że gdybyśmy mogli stworzyć taką sieć połączonych ze sobą osób, bylibyśmy w stanie rozwiązać znacznie trudniejsze zagadki niż teraz. Czy będzie można tak wewnętrznie współpracować? Teraz współpracujemy, owszem, ale mamy barierę języka, a przecież potrafimy myśleć znacznie szybciej, niż komunikować się. Może odpowiedzielibyśmy na pytania, na które teraz nie potrafimy odpowiedzieć?

Na przykład?

Na przykład: jak poradzić sobie z globalnym ociepleniem?

Fantastyczny pomysł.

Wiem, ja zawsze mam fantastyczne pomysły. Ale to się wszystko naprawdę dzieje. Zaczyna się od science fiction, a potem science fiction staje się prawdą.

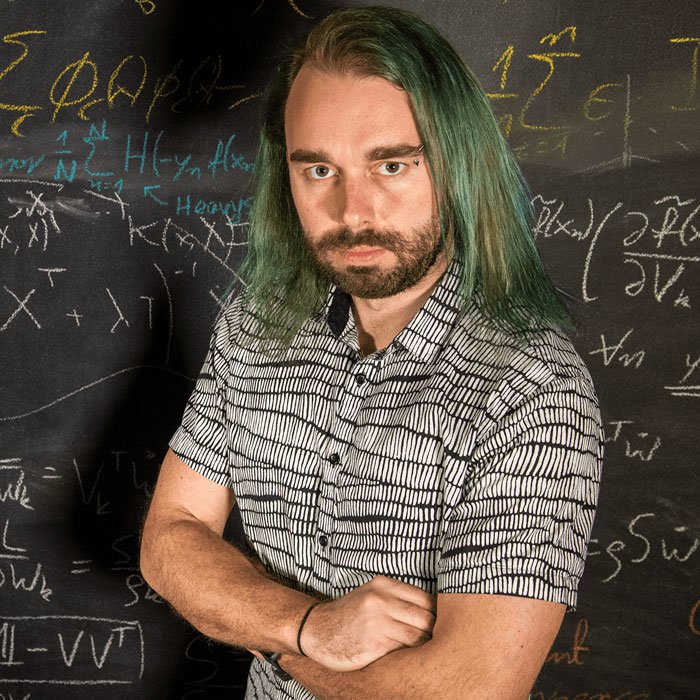

*Dr Andrzej Banburski pracuje w Center for Brains, Minds and Machines i Poggio Lab w MIT. Studiował fizykę matematyczną na uniwersytecie w Edynburgu, a następnie w Perimeter Institute for Theoretical Physics w Kanadzie. Tam też doktoryzował się z kwantowej grawitacji.