- Co wspólnego mają Demi Moore i Ashton Kutcher z dziecięcą pornografią?

- Systemy rozpoznawania twarzy wyłuskują przestępców i nieletnie ofiary

- Firmy znaczą niedozwolone zdjęcia i wideo cyfrowym odciskiem palca

Policja w Nadrenii Północnej-Westfalii (NRW) testuje sztuczną inteligencję, która identyfikuje zdjęcia i strony internetowe z dziecięcą pornografią. Nic nowego? A jednak – platforma ma też pomóc ustalać tożsamość sprawców i ofiar, co znacznie ułatwi pracę śledczych.

Nowe algorytmy na usługach niemieckich śledczych i prokuratorów będą pomagać odfiltrowywać niedozwolone zdjęcia od zalewu innych obrazów, w miarę możliwości identyfikować twarze sprawców i ofiar, oddzielać już notowanych od nieznanych sprawców przestępstw, wychwytywać zdjęcia, które krążą w sieci mimo wcześniejszych spraw prowadzonych przeciwko ich dystrybutorom itp. W sierpniu w Düsseldorfie minister sprawiedliwości Peter Biesenbach ogłosił stosowny projekt badawczy. Współpraca między policją, Microsoft Germany GmbH, naukowcami z Uniwersytetu Saary i firmą LytiQ GmbH już trwa.

W NRW rozpowszechnianie dziecięcej pornografii w sieci jest bardzo częstym przestępstwem. Do połowy czerwca w tym najliczniejszym niemieckim kraju związkowym toczyło się około 1900 spraw dotyczących podejrzeń o wykorzystywanie dzieci lub o rozpowszechnianie pornografii dziecięcej. W trakcie oceny materiału dowodowego było 12 spraw, a na wykonanie czekało 557 nakazów przeszukania. Policja w NRW, licząca ponad 40 tysięcy funkcjonariuszy, dysponuje zaledwie setką etatów ekspertów od cyberprzestępczości na tle seksualnym. Tymczasem według biura zajmującego się pornografią dziecięcą skala dotyczy niewyobrażalnej ilości zdjęć o objętości około trzech petabajtów.

Darknet i prywatność

Pornografia dziecięca jest w Niemczech obok handlu bronią i narkotykami głównym obszarem przestępczym w ukrytej części internetu zwanej Darknetem. Niestety przetwarzanie danych z pornografii dziecięcej podlega bardzo szerokim ograniczeniom prawnym. Zastosowanie technik sztucznej inteligencji opartych na przetwarzaniu niedozwolonych zdjęć w chmurze i z pomocą sieci neuronowych było w Niemczech dotychczas niemożliwe.

Współpraca partnerów projektu i konstruktywny dialog między różnymi dyscyplinami specjalistycznymi dały rozwiązanie: zastosowanie tzw. chmury hybrydowej. To taka, która łączy infrastrukturę lokalną, czyli chmury prywatne, z chmurami publicznymi, dane mogą być przenoszone między nimi. Wrażliwy materiał źródłowy będzie przetwarzany wyłącznie na komputerach wymiaru sprawiedliwości tak, aby można było wykorzystać przetwarzane dane do szkolenia sztucznej inteligencji specjalizującej się w wykrywaniu pornografii dziecięcej.

Brytyjczycy sprawdzają

Różne inteligentne systemy pracują w innych krajach. Dla przykładu tworzona od 2003 roku w Zjednoczonym Królestwie komputerowa baza danych rozpoznawania twarzy, porównująca zdjęcia skrzywdzonych dzieci, kilkakrotnie przyspieszyła polowanie na pedofilów, którzy wykorzystują internet jako miejsce swoich zwyrodniałych zachowań.

Specjaliści rozpoczęli tworzenie tzw. Childbase ze zdjęć i filmów odzyskanych z komputerowych dysków twardych z nadzieją na zidentyfikowanie podejrzanych. Jednakże twarze przeważającej większości przestępców były zasłonięte, częściowo lub całkowicie. Ale można ich rozpoznać np. po tatuażach.

Z pomocą przyszła kanadyjska firma Face Forensics, która przeprojektowała system, aby skompilować obrazy tatuaży i odpowiednio identyfikować podejrzanych. Opracowała także sposób cyfrowego tworzenia pełniejszych obrazów twarzy z częściowo zaciemnionych oryginałów. System porównuje też zdjęcia dzieci – dzięki odwzorowaniu rysów twarzy, takich jak oczy, nos i usta szybko ustala, czy znane są policji jako ofiary pornografii dziecięcej, czy też to nowe zdjęcia z nieznanymi dotąd dziećmi.

System eliminuje pracochłonne przeglądanie stosów albumów fotograficznych, zdjęć niejednokrotnie wstrząsających dla samych detektywów. Zapobiega również powielaniu śledztw i umożliwia policji koncentrowanie się na nowych sprawach.

„Morfotwarz” Interpolu

Działająca na terenie blisko 200 państw światowa organizacja policyjna w ramach projektu „INTERPOL 2020” wciąż rozszerza swoje możliwości rozpoznawania twarzy. Dwa lata temu, po przeprowadzeniu testu, Sekretariat Generalny Interpolu w Lyonie utworzył nową bazę danych biometrycznych. Pod koniec ubiegłego roku zawierała już ponad setki tysięcy rekordów ze zdjęciami i portretami przestępców.

Adres filmu na Youtube: https://www.youtube.com/watch?v=KzJ1hf_73BY

Źródło: IDEMIA / YouTube

Pliki są przeszukiwane za pomocą oprogramowania „MorphoFace Investigate” firmy Idemia, będącej częścią międzynarodowej grupy Safran Identity & Security (z jej rozwiązań korzystają też policje różnych krajów). Od 2016 roku jednostki Interpolu wykorzystują systemy MorphoFace aż w 192 krajach.

PhotoDNA

We wrześniu ubiegłego roku Google zaprezentowała sztuczną inteligencję, która wykrywa nowe materiały z pornografią dziecięcą w internecie. Jak twierdzą twórcy, siedmiokrotnie przyspiesza pracę, filtrując wyniki wyszukiwania zdjęć, które nie zostały wcześniej otagowane tzw. PhotoDNA. To unikalny podpis cyfrowy obrazu, który jest porównywany z podpisami innych zdjęć w celu znalezienia kopii tego samego zdjęcia.

System opracował Microsoft wraz z Dartmouth College, a od 2013 roku Facebook, Microsoft, Google i Twitter współpracują, nadając przestępczym zdjęciom PhotoDNA i wysyłają do baz danych, również organizacji non-profit, wykorzystywanych przez śledczych.

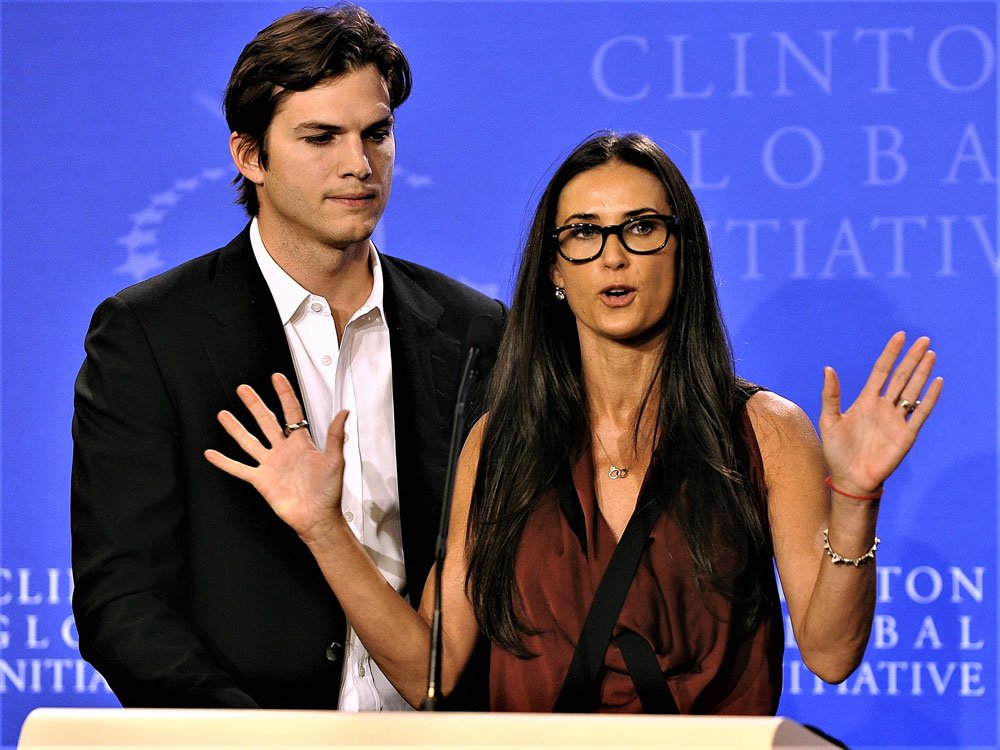

Stoi za tym Demi Moore

Jedną z nich jest amerykańska organizacja Thorn, założona przez aktorów Demi Moore i Ashtona Kutchera. Oferuje ona dwa narzędzia do walki z cyberprzestępstwami wobec dzieci – Spotlight oraz Safer. Narzędzie Spotlight wykorzystuje algorytmy przetwarzania tekstu i obrazu, aby dopasować twarze i inne wskazówki m.in. w reklamach internetowych, zachęcających do odwiedzin stron pornograficznych, korzystając z technologii rozpoznawania twarzy firmy Amazon zwanej Rekognition.

Do partnerów Thorna oprócz Amazona należą Dropbox i Facebook, który twierdzi, że w pierwszym kwartale 2019 r. podjął działania dotyczące 5,4 mln obrazów pornografii dziecięcej.

Jak podaje Thorn, organy ścigania wykorzystały Spotlight w prawie 40 tysiącach spraw w całej Ameryce Północnej, w których śledczy znaleźli ponad 9 tysięcy nieletnich ofiar i ponad 10 tysięcy przestępców.

Drugim ważnym produktem oprogramowania Thorna jest Safer, zbudowany za pomocą różnych technologii przetwarzania obrazu. Pomaga firmom technologicznym wykrywać obrazy przedstawiające wykorzystywanie seksualne dzieci na swoich platformach właśnie za pomocą PhotoDNA.

Po nitce …

Kanadyjska organizacja non-profit Centrum Ochrony Dzieci działa w oparciu o oprogramowanie o nazwie Project Arachnid, które przeszukuje ciemną sieć i zwykłe strony internetowe w celu wykrycia obrazów przedstawiających wykorzystywanie dzieci i automatycznie powiadamia operatorów stron z prośbą o ich usunięcie. Przetwarzając dziesiątki tysięcy obrazów na sekundę, Arachnid wykrywa zawartość w tempie znacznie przewyższającym tradycyjne metody identyfikacji i usuwania przestępczego materiału. Pomaga również śledczym znaleźć nowe treści. W ciągu dwóch i pół roku Arachnid przeszukał 85 miliardów obrazów i wysłał 4,2 miliona powiadomień.

Różne prawo i prywatność

Czy sztucznej inteligencji raz na zawsze uda się ukrócić rozpowszechnianie w sieci dziecięcej pornografii?

„Zagrożenia dla najmłodszych internautów to problem globalny, przybierający wszędzie podobne formy. (…) Sprawcy takich czynów są trudni do wykrycia z uwagi na niejawny charakter kontaktów przez internet” – napisała Barbara Główczewska w Kortowskim Przeglądzie Prawniczym, czasopiśmie studenckim Wydziału Prawa i Administracji Uniwersytetu Warmińsko-Mazurskiego w Olsztynie.

Gdy dla przykładu w 2014 roku SI Google’a wychwyciło zdjęcie z pornografią dziecięcą otagowane PhotoDNA w prywatnej wiadomości wysłanej przez przestępcę i firma powiadomiła o tym policję, rozgorzała dyskusja na temat prywatności użytkowania poczty Gmail.

„Ważne jest, aby pamiętać, że używamy tej technologii tylko do identyfikacji zdjęć przedstawiających niegodziwe traktowanie dzieci w celach seksualnych, a nie innych treści e-mail, które mogłyby być powiązane z działalnością przestępczą, na przykład za pomocą poczty e-mail w celu wykrycia włamania” – brzmiało oświadczenie Google. 41-letni kucharz został aresztowany i skazany jako recydywista.

Do obaw o naruszanie prywatności korespondencji przez systemy rozpoznawania twarzy, które uruchamiają społeczne protesty, dochodzą problemy z transgranicznym wymiarem przestępstwa – np. to co w Rosji nie będzie uznawane za dziecięcą pornografię (bo dotyczy dzieci powyżej 14 lat), w Niemczech czy w Polsce już tak.

Policjanci z Katowic pod koniec sierpnia zatrzymali pedofila z Białegostoku, który m.in. rozpowszechniał w sieci pornografię dziecięcą. Jeszcze bardziej obrzydliwy jest fakt, że zwyrodnialec dla zmylenia tropu policji przedstawiał się jako łowca pedofilów. Grozi mu do 15 lat więzienia. Śledztwo, które doprowadziło do zatrzymania przestępcy, trwało dwa lata.